Actualizado el lunes, 11 diciembre, 2023

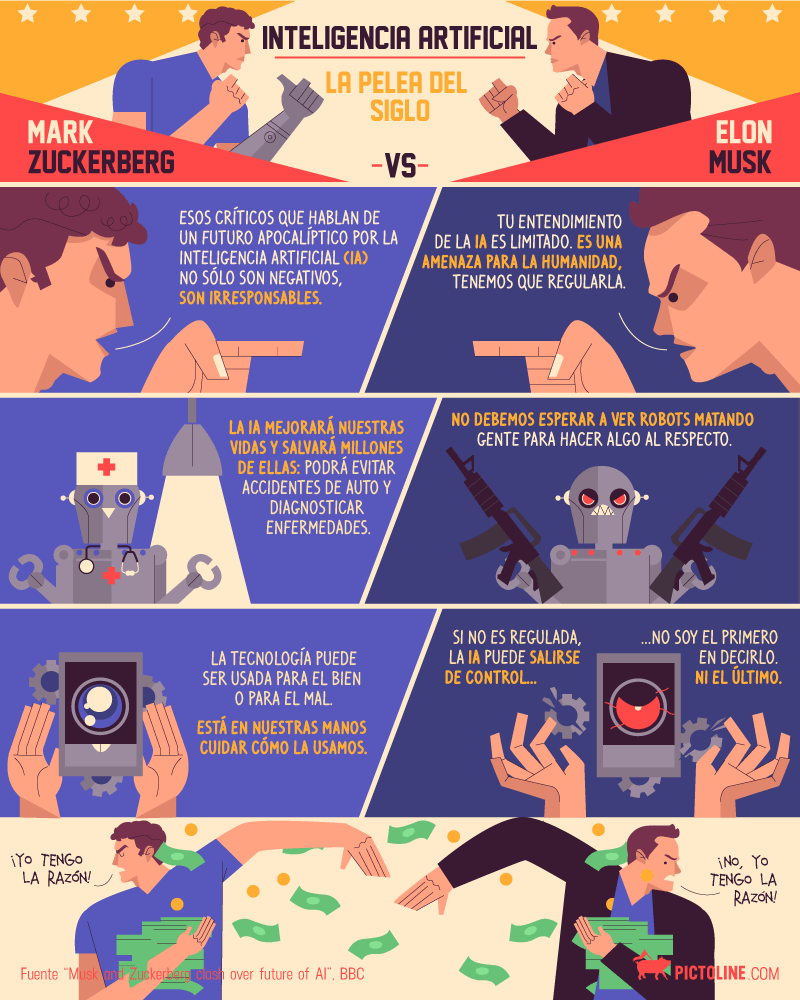

Ya sean las últimas películas de ciencia ficción o simplemente las noticias cotidianas, parece que la inteligencia artificial se puede encontrar en todas partes. Pero quizás como era de esperar, hay poco acuerdo sobre los detalles que rodean a la IA: ¿conducirá la automatización a un desempleo masivo? ¿Los coches tradicionales pronto serán reemplazados por vehículos autónomos? ¿Estamos destinados a ser subyugados por señores robóticos?

A pesar de la amplia variación en las opiniones sobre estos temas, a menudo son las voces más pesimistas y melodramáticas las que ocupan un lugar central en las discusiones sobre la IA y sus efectos potenciales.

Por supuesto, AI hace plantear algunas amenazas reales a nuestra economía. Pero al enfocarnos solo en las desventajas, ignoramos el potencial de la IA para remodelar el mundo, redefinir el trabajo y brindar importantes beneficios a la atención médica, entre muchos otros beneficios. Estas claves sobre la inteligencia artificial proporcionan una visión holística de la IA, desde la forma en que funciona hasta las formas en que podría ayudarnos o dañarnos en el futuro. En el camino, obtendrá una idea general de las opiniones de los 23 expertos en inteligencia artificial que el autor entrevistó para hacer su libro.

Gracias a los avances en el aprendizaje profundo y las redes neuronales, la inteligencia artificial se ha vuelto excelente para completar tareas específicas y limitadas. Sin embargo, todavía estamos muy lejos de la era de la Inteligencia General Artificial, que requerirá avances en el aprendizaje no supervisado, los sistemas híbridos y la neurociencia. Incluso si no vemos surgir AGI en nuestra vida, es probable que el papel de la IA en la atención médica y el ejército continúe creciendo, presentando nuevos desafíos y brindando importantes beneficios para la humanidad.

Diferentes métodos de aprendizaje profundo pueden entrenar a la IA para completar tareas

Piense en cuando era niño. ¿Recuerdas la primera vez que viste un gato o una foto de un gato? ¿Cuántos gatos necesitaste ver antes de entender completamente qué era exactamente un gato ?

Lo más probable es que solo necesitara ver uno o dos antes de poder diferenciar fácilmente un gato de otro animal. Este tipo de aprendizaje, que implica ver una cantidad muy pequeña de ejemplos, es fácil y natural para los humanos, pero para una IA es muy difícil. Para que una IA comprenda qué hace que un gato sea un gato, debe estar entrenado. Hoy en día, eso sucede a menudo a través del aprendizaje profundo, una forma de aprendizaje automático que ha impulsado la mayoría de los grandes avances en IA durante la última década.

Ya sea que una IA esté siendo entrenada para reconocer gatos, perros o tazas de café, todo comienza con una red neuronal . Este es un software con múltiples capas de «neuronas» que imitan las que se encuentran en el cerebro humano.

Hay algunos métodos diferentes que los científicos usan comúnmente para entrenar redes neuronales. Uno es el aprendizaje supervisado , un tipo de aprendizaje profundo en el que una IA recibe un conjunto de ejemplos de entrenamiento, cada uno etiquetado con una descripción. Una vez que la IA ha sido entrenada, podríamos mostrarle una imagen de un gato. A continuación, la colección de píxeles de la imagen fluye a través de la red neuronal, después de lo cual la máquina confirmará, esperamos, que lo que «ve» es, de hecho, un gato.

Incluso si adivina correctamente, esta IA todavía no tiene la menor idea de lo que significa la palabra «gato»: no sabe lo que hace un gato o si está vivo. Para que una IA desarrolle esta comprensión, debe enseñarse mediante un aprendizaje de idiomas basado en la base . Este es un enfoque de aprendizaje profundo en el que las oraciones o palabras se asocian con imágenes, videos u objetos del mundo real.

Todas estas técnicas permiten que el aprendizaje profundo tenga todo tipo de aplicaciones potenciales. Por un lado, el aprendizaje de idiomas basado en la base podría ayudar a desarrollar las habilidades lingüísticas de la IA, lo que la hace útil en asistentes personales como Siri. Y el aprendizaje profundo ya se ha utilizado para entrenar a la IA para jugar. En uno de los casos más famosos, el AI AlphaGo fue entrenado observando muchos juegos de Go, y finalmente pudo vencer al mejor campeón humano en su propio juego.

El aprendizaje profundo es limitado

Es difícil no quedar impresionado cuando vemos una IA derrotando a los mejores jugadores humanos en ajedrez, Go o shogi. Pero por monumental que sea, no significa que estemos más cerca de lograr algún tipo de inteligencia general. La IA sigue siendo buena para completar tareas específicas y limitadas.

Tome AlphaZero. Fue entrenado a través del aprendizaje profundo para jugar juegos de mesa deterministas, de dos jugadores y completamente observables, como el ajedrez y el Go. A pesar de la habilidad de AlphaZero en estos juegos, sería completamente inútil que se le pida que aprenda a jugar cualquier otro tipo de juego, como, por ejemplo, el póquer.

A diferencia del ajedrez o el Go, el póquer es un juego de información parcial. Es solo parcialmente observable , lo que significa que no puedes ver el «tablero» completo mientras juegas. Entonces, una IA para jugar al póquer requiere algoritmos diseñados para estimar movimientos que la máquina no puede ver. AlphaZero no puede hacer eso. Está diseñado para asumir que el juego que está jugando incluye solo las piezas del tablero.

Entonces, a partir de ahora, la IA solo puede completar una tarea para la que está específicamente capacitada. Pero otro problema importante con el aprendizaje profundo y las redes neuronales está en los datos que usamos para enseñarles.

No es ningún secreto que los humanos pueden ser parciales, incluso si no es nuestra intención. Por ejemplo, cuando se trata de vigilancia, las estadísticas muestran que algunos vecindarios están más patrullados que otros, lo que significa que, en última instancia, tenemos más datos sobre esos vecindarios que sobre otros. Si se entrena a una IA con estos datos sesgados, el sistema podría terminar haciendo predicciones sesgadas sobre dónde es más probable que ocurra el crimen.

Los límites de las técnicas de aprendizaje profundo significan que probablemente no podamos usar ninguna de ellas para alcanzar la siguiente etapa del desarrollo de la IA: Inteligencia General Artificial o AGI. Una máquina así necesitaría sentido común o la capacidad de hacer inferencias sobre situaciones en las que nunca se había encontrado antes.

Pero ese desafío no ha disuadido a los investigadores de explorar métodos para hacer esto. Hay algunas formas de intentar dar sentido común a las máquinas. Básicamente, una forma implica introducir tantos bits de conocimiento en el «cerebro» de una IA como sea posible en forma de reglas lógicas. Sin embargo, esta técnica no es muy práctica, ¡ya que hay un número infinito de posibles reglas y situaciones! Alternativamente, algunos investigadores esperan que el sentido común emerja a través de máquinas que simplemente observan el mundo y aprenden cómo funcionan las cosas, de una manera no estructurada.

Pero puede haber otra opción: los científicos podrían crear AGI utilizando un sistema híbrido que combina redes neuronales y reglas lógicas tradicionales. Veremos más de cerca cómo en las siguientes claves sobre la inteligencia artificial.

Los sistemas híbridos podrían ser la clave para nuevas mejoras en la IA

A lo largo de los años, diferentes técnicas de aprendizaje automático han ido perdiendo popularidad. Este fenómeno es exactamente lo que sucedió con el concepto de aprendizaje profundo. La técnica surgió ya en la década de 1950, pero fue descartada como inútil en la década de 1960; sin embargo, hoy es una vez más el método dominante de aprendizaje automático.

Sin duda, el aprendizaje profundo jugará un papel en la IA del futuro, pero sus limitaciones significan que no puede ser la única técnica que usamos para crear AGI. Más bien, el desarrollo de AGI puede requerir que los investigadores combinen varios métodos diferentes de aprendizaje automático para crear un sistema híbrido.

Los cerebros humanos se construyen con la capacidad innata de aprender: los niños son nuestro único ejemplo de inteligencia que se escala de manera confiable a partir de algo menos que la inteligencia humana adulta. Debido a esto, muchos investigadores de IA están estudiando a niños con la esperanza de descubrir las estructuras subyacentes en el cerebro que nos permiten aprender.

Un neurocientífico e investigador, Demis Hassabis, cree que combinar el aprendizaje por refuerzo con otras técnicas ofrece el camino más viable hacia el AGI. En los humanos, esto sucede a través de nuestro sistema de dopamina, donde las sinapsis de nuestro cerebro se fortalecen cuando reciben señales de recompensa. Podemos imitar esto en la IA pidiéndole a una máquina que intente repetidamente una tarea y la “recompense” cada vez que tenga éxito.

Por supuesto, los humanos también aprenden de muchas otras formas. Hacemos mucho aprendizaje sin supervisión , donde deambulamos y recopilamos conocimientos a través de la exploración. Si los científicos pueden descubrir cómo hacer que la IA aprenda de esta manera, sin que tengamos que proporcionarle toneladas de datos, es casi seguro que lograremos un gran avance en el desarrollo de AGI.

De manera similar a los cerebros humanos, la IA podría potencialmente construirse con una estructura subyacente y luego entrenarse con técnicas de aprendizaje profundo sobre ella. Un sistema híbrido como este, aunque potencialmente complejo en su aplicación, no es nuevo. Ya se está utilizando en los coches autónomos de hoy.

¿Cómo es eso? Bueno, los autos autónomos deben poder comprender qué decisiones tomar en la carretera. Parte del conocimiento de los automóviles puede provenir de los datos obtenidos a través del aprendizaje profundo, pero no todas las situaciones son predecibles. Eso significa que los humanos deben construir reglas que imaginen situaciones que los autos podrían encontrar y cuáles deberían ser sus respuestas.

Los vehículos autónomos son realmente emocionantes, pero hay muchas más aplicaciones para la IA. Veamos algunos de esos a continuación.

La inteligencia artificial tiene el potencial de hacer la vida más fácil y mejor para todos

En el pasado reciente, se ha hablado mucho sobre el potencial de la IA para reforzar los prejuicios y estereotipos que los humanos podrían programar involuntariamente en ellos. Muchos investigadores académicos comprenden el problema del sesgo cuando se trata de la IA y están modificando algoritmos para responder a él. Pero, esto podría invertirse y usarse a nuestro favor: podríamos usar la IA para eliminar los sesgos.

Es mucho más difícil concentrarnos y corregir los prejuicios en nosotros mismos. Pero, como señala el científico informático Fei-Fei Li, cuando vemos nuestros propios prejuicios reflejados en nosotros a través de la tecnología, podemos encontrar formas de corregirlos. Por tanto, eliminar los prejuicios es solo un ejemplo de la capacidad de la IA para mejorar la vida de las personas.

El uso de IA para erradicar el sesgo no es poco realista: de hecho, ya se está utilizando en Affectiva. Affectiva fue creada por la científica informática y emprendedora Rana el Kaliouby, quien cree que debemos comenzar a pensar en la inteligencia emocional de las máquinas en lugar de solo en su «inteligencia».

Affectiva ha utilizado algoritmos y técnicas de procesamiento del lenguaje natural para crear una herramienta de contratación de IA anti-sesgo. En lugar de currículums escritos, los candidatos envían entrevistas en video, que la IA clasifica según las habilidades de comunicación no verbal de los candidatos y las respuestas a las preguntas. ¿El resultado? En Hirevue, una empresa que probó el sistema, el tiempo de contratación se redujo en un 90 por ciento y la diversidad de nuevas contrataciones aumentó en un 16 por ciento.

Otro de los proyectos de el Kaliouby está diseñado para ayudar a los niños en el espectro del autismo, que a menudo tienen dificultades para interpretar las emociones de otras personas. Ella y otros en su laboratorio crearon un tipo especial de anteojos que pueden «leer» las emociones de las personas y dar retroalimentación al usuario sobre esas emociones. Los niños que usaban gafas terminaron haciendo más contacto visual y experimentaron una mayor comprensión al mirar las caras de las personas.

Aparte de estos usos especializados para la IA, hay muchas otras formas en que la inteligencia artificial puede ayudar a la persona promedio. Esto podría comenzar con robots que puedan hacerse cargo de tareas rutinarias y mundanas como doblar la ropa, liberando así nuestro tiempo.

Pero no se detiene ahí. Según Ray Kurzweil, director de ingeniería de Google, es probable que algún día tengamos nanorobots flotando en nuestro torrente sanguíneo. Estos robots microscópicos podrían ayudar potencialmente a nuestro sistema inmunológico, extender nuestras vidas e incluso conectar nuestro cerebro a Internet.

La inteligencia artificial ayuda a los avances científicos, particularmente en la atención médica

Si ingresa a cualquier hospital o centro de atención en Estados Unidos hoy en día, es probable que encuentre muchos médicos y enfermeras estresados. En estos días, los profesionales de la salud trabajan en turnos largos, tienen horarios ajustados y son altamente susceptibles al agotamiento y al estrés.

No solo eso, los médicos y enfermeras apresurados significan que los pacientes están recibiendo una atención de menor calidad de la que recibirían de otra manera. De hecho, la tercera causa de muerte actual en los hospitales estadounidenses es el error médico. (Si te ha gustado este post, te recomendamos estas frases de Florence Nightingale te mostrarán más citas inspiradoras sobre la vocacional labor de enfermería y la rama médica).

Afortunadamente, la atención médica es un área en la que la IA tiene el potencial de ser de gran ayuda. Entonces, como argumenta el empresario Oren Etzioni, al optar por no tomar medidas activas para integrar la inteligencia artificial y la atención médica, en realidad estamos permitiendo que se pierdan más vidas.

La atención médica es una industria masiva y hay una amplia variedad de formas en que la IA se puede usar dentro de ella.

A partir de ahora, las redes neuronales se pueden entrenar para reconocer cuando una imagen contiene una imagen de, digamos, una taza de café. Esas mismas redes neuronales también podrían entrenarse para reconocer cuándo está presente un tumor en una exploración radiológica, por ejemplo.

De manera similar, diagnosticar enfermedades mentales como la depresión es difícil en este momento porque dependemos principalmente de los autoinformes de síntomas, como los pensamientos suicidas. Pero también sabemos que existen ciertos biomarcadores faciales y vocales de la depresión; simplemente, son difíciles de detectar para los humanos. Sin embargo, para una IA con la capacidad de realizar escaneos faciales y de audio, podría ser bastante simple.

Si los robots pudieran hacerse responsables de una parte de la atención al paciente, el tiempo de los médicos y enfermeras podría liberarse y reasignarse a donde realmente se necesita. Los algoritmos podrían usarse para interpretar la información del paciente y proporcionar retroalimentación a los médicos, pacientes y miembros de la familia, lo que ahorraría tiempo y mejoraría la comunicación.

Pero los beneficios de la IA cuando se trata de ciencia no se limitan solo a la atención médica. También podría ayudar potencialmente en el campo de la investigación científica. Tome el proyecto Semantic Scholar, dirigido por Oren Etzioni. Para mantenerse al día sobre las últimas investigaciones, los científicos deben leer una gran cantidad de publicaciones. Semantic Scholar ayuda mostrándoles los artículos que probablemente deseen leer y localizando hallazgos importantes dentro de esos artículos.

Hasta ahora, hemos discutido todo lo bueno que la IA puede hacer por el mundo, pero veremos algunas de las posibles desventajas.

La inteligencia artificial podría convertirse en un arma

No es ningún secreto que las capacidades destructivas de la humanidad han aumentado enormemente con el tiempo, desde los arcos y flechas de la época medieval hasta las bombas y drones especializados que la mayoría de los ejércitos utilizan en la actualidad.

En estos días, incluso los ciudadanos promedio tienen acceso a drones que potencialmente podrían armar con bombas pequeñas. Sin embargo, afortunadamente, este tipo de arma no es escalable. Cada dron solo puede contener una bomba y ser pilotado por una sola persona, lo que significa que sus capacidades destructivas son limitadas.

En teoría, por supuesto, cualquier arma puede producirse en masa y usarse para armar al ejército de un país. Pero, afortunadamente, contamos con sanciones internacionales y preparación militar para prevenir estos hechos. Lo que no tenemos actualmente es un sistema internacional de control sobre armas autónomas, que podría darle a una sola persona el control remoto de una flota completa de drones mortales.

Una de las principales razones por las que las armas autónomas son tan potencialmente peligrosas es que son altamente escalables. Una flota masiva de, digamos, 10 millones de drones autónomos podría ser supervisada por solo cinco personas que trabajan en una sala de control y lanzada con solo tocar un botón. Además, estas armas autónomas podrían programarse para atacar o matar a personas específicas, por ejemplo, todos los hombres entre las edades de 12 y 60 en un país determinado.

Y existen otros riesgos importantes que conlleva el desarrollo de armas autónomas. Por un lado, pronto podría haber una carrera armamentista entre países que intentan ser los primeros en crear esta tecnología. Las armas autónomas también serían vulnerables a la piratería del enemigo, lo que significa que un país podría terminar siendo atacado por sus propias armas.

Dados estos problemas concebibles, es esencial que mientras continuemos desarrollando tecnología de armas autónomas, entendamos los riesgos y tomemos las medidas preventivas necesarias. Las regulaciones gubernamentales son una forma de protegerse contra el mal uso de la tecnología, y los investigadores deben asegurarse de diseñar los sistemas más seguros posibles desde el principio.

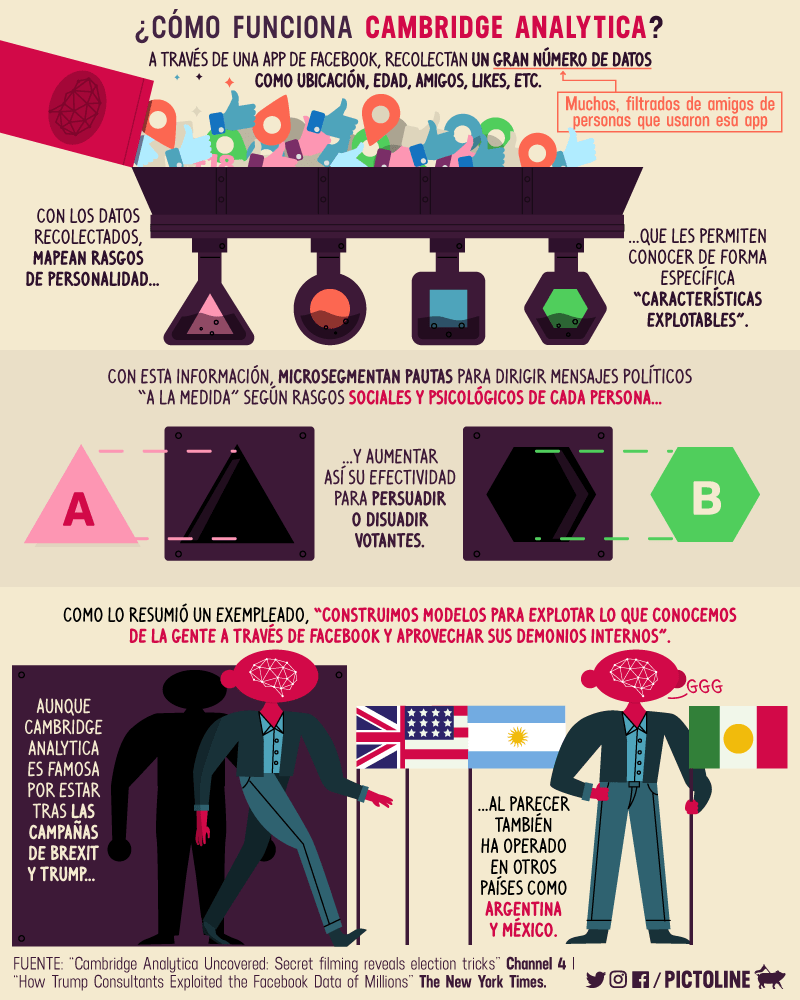

Por supuesto, hay otras formas en que la IA podría armarse además de las armas reales. La publicidad, por ejemplo, podría utilizar técnicas de aprendizaje automático para influir en la forma en que la gente vota. De hecho, esto ya sucedió cuando Cambridge Analytica usó los datos de los usuarios de Facebook para ayudar a la campaña Trump de 2016.

Pero puede haber algo aún más preocupante que este tipo de armas: la amenaza de pérdida de empleo a gran escala.

La renta básica universal podrían resolver el problema de la automatización del trabajo

Imagina que, en diez años, nunca tendrás que trabajar un día más en tu vida. ¿Suena eso como una utopía o una pesadilla?

Cualquiera que sea su respuesta, la creciente presencia y habilidad de la IA, especialmente cuando se trata de completar de manera eficiente tareas repetitivas, puede significar que muchos trabajos pronto se automatizarán. Algunos ejemplos comúnmente citados de personas que pronto podrían quedarse sin trabajo son cajeros, camioneros, contadores y trabajadores de fábricas.

Entonces, ¿cómo sobrevivirá la gente cuando ya no pueda trabajar para generar ingresos? Bueno, hay una variedad de soluciones a este problema, aunque la mayoría de las personas que el autor entrevistó estuvo de acuerdo en que alguna forma de ingreso básico universal, o RBU, será necesaria en el futuro.

A largo plazo, la RBU podría ser necesaria si se automatiza un sector suficientemente grande de la economía de un país. La IA podría aumentar drásticamente la productividad empresarial, generando ingresos que podrían distribuirse a los ciudadanos de un país en forma de estipendio mensual.

La pregunta es: ¿Será realmente necesaria la RBU? Después de todo, siempre que ha habido una revolución tecnológica masiva a lo largo de la historia, la gente ha predicho la pérdida de puestos de trabajo a gran escala. Por supuesto, algunos trabajos han hecho desaparecer con el tiempo – pero los nuevos siempre han aparecido en su lugar. Hace solo unos años, por ejemplo, no había trabajos relacionados con las redes sociales. ¡Ahora, hay muchos!

Para las personas cuyos trabajos no automatizado, los programas de educación robustas podrían ser una solución. Los países podrían incluso adoptar una política de pagar a los desempleados para que estudien y establezcan nuevas carreras, una propuesta a la que a menudo se hace referencia como ingreso básico condicional.

Afortunadamente, es probable que simplemente no aceptemos que todos los aspectos de nuestras vidas sean dirigidos por robots. Seguiremos valorando las experiencias que implican una conexión humana. Hoy en día, por ejemplo, es posible comprar música digital por unos pocos dólares. Pero asistir a un concierto en vivo, puede costarle unos cientos de dólares. Por lo tanto, es probable que las profesiones que se centran en inspirar a las personas y crear conexiones se vuelvan aún más remuneradas a medida que los robots se integren cada vez más en nuestras vidas.

Sí, la pérdida de empleo es preocupante, pero algunos investigadores creen que deberíamos centrar nuestra atención en una amenaza aún mayor que representa AGI. Creen que esta tecnología tiene el potencial de provocar un apocalipsis.

Las posibles desventajas de la Inteligencia General Artificial son muy controvertidas

Sin duda, el auge de la IA ha traído consigo una gran cantidad de preocupaciones. Pero tal vez ninguno haya sido tan publicitado como la amenaza que representa la AGI de apariencia humana. ¿Qué sucede si los robots eclipsan a la humanidad y se vuelven más rápidos, inteligentes y fuertes que todos nosotros?

Un mundo dominado por los señores de los robots es probablemente un escenario estrictamente de ciencia ficción. Pero según el filósofo Nick Bostrom y algunos otros investigadores, vale la pena considerar cómo la misión de crear AGI podría terminar saliendo muy mal.

Si alguna vez ha oído hablar del problema de los clips , propuesto por primera vez por Nick Bostrom, le han presentado uno de los experimentos mentales más famosos que ilustra los peligros potenciales de AGI.

Imagine que una IA tiene la tarea de operar una fábrica de clips. Con el tiempo, la IA se vuelve cada vez mejor y más eficiente en el funcionamiento de la fábrica y la creación de clips. Finalmente, la IA se vuelve tan inteligente que se da cuenta de que la mejor manera de hacer clips es arrebatarle el control a la humanidad y convertir el mundo entero en clips.

Este escenario es intencionalmente caricaturesco, pero está destinado a mostrar cómo la IA podría volverse demasiado buena para lograr los objetivos con los que la programamos.

La mayoría de los investigadores que el autor entrevistó cree que el ejemplo de Bostrom no es realista, y hay varias formas de evitar el escenario del clip. Por un lado, simplemente no le daría a una IA que hace clips de papel el poder de controlar, por ejemplo, una red eléctrica. Además de eso, se asegurará de diseñar la IA con un sistema de valores y una concepción de lo correcto y lo incorrecto, de manera que no esté programada con el único propósito de crear tantos clips como sea posible.

Hay aún más formas de protegerse contra una adquisición de AGI. Uno de los más radicales ha sido propuesto por Bryan Johnson, quien cree que necesitamos mejorar la humanidad misma, no solo las máquinas. Para ello, Johnson ha creado una empresa llamada Kernel, con el objetivo de utilizar la neurociencia para «hackear» nuestro cerebro y aumentar nuestras capacidades cognitivas a través de un implante de chip de computadora u otro dispositivo.

Los expertos no están de acuerdo sobre el cronograma exacto en el que alcanzaremos el AGI. Pero lo importante es que nos tomemos estos problemas en serio y nos preparemos para un mundo que pronto compartiremos con máquinas cuya inteligencia rivaliza con la nuestra.